دانشآموزان تنها توانایی یادگیری خود را تضعیف نمیکنند، بلکه توانایی رهبری در آیندهٔ خود را نیز به خطر میاندازند.

توسط ویل تیگو

نویسنده مهمان

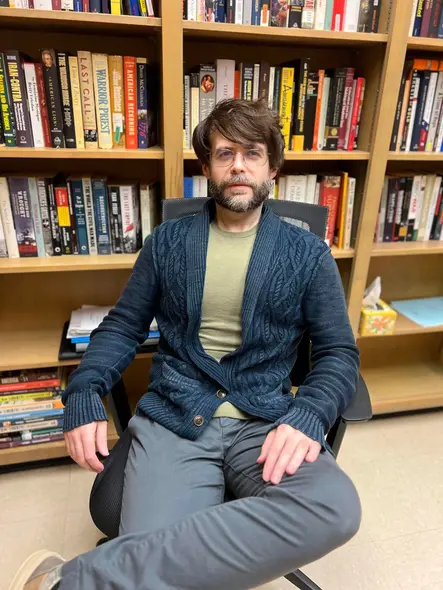

به مدت دهسال گذشته بهطور مداوم در کلاسهای دانشگاه حضور داشتهام. من بهعنوان مدرس جزئی در یک کالج جامعهای کار کردهام، در یک مؤسسهٔ تحقیقاتی بزرگ بهعنوان مدرس دورهٔ تحصیلات تکمیلی تدریس کردهام، و در حال حاضر استادیار تاریخ در یک دانشگاه کوچک با تمرکز بر تدریس هستم.

از ترم بهاری ۲۰۲۳ به وضوح مشهود شد که تعداد دانشآموزانی که کارهای تولیدشده توسط هوش مصنوعی را ارائه میدهند، روز به روز در حال افزایش است. من با دانشآموزانی که سعی میکردند با کپیبرداری و چسباندن از ویکیپدیا راهحلی راحت پیدا کنند، آشنایی ندارم، اما ورود هوش مصنوعی مولد به آنها این امکان را داد تا به شکل شگفتانگیزی جدید تقلب کنند و بسیاری از دانشآموزان بهصورت کامل از این ابزار استفاده کردند.

آشکارسازهای سرقت ادبی به اندازه کافی برای آنچه که میتوانم «تقلب کلاسیک» بنامم مؤثر عمل میکنند، اما بهطور شناختهشدهای در تشخیص کارهای تولیدشده توسط هوش مصنوعی ضعیف هستند. حتی برنامهای مثل Grammarly که ظاهراً فقط برای پاکسازی کارهای خود کاربر طراحی شده است، میتواند هشدارهایی ایجاد کند.

بنابراین، در این ترم تصمیم گرفتم با دقت بیشتری به دنبال کارهای هوش مصنوعی بگردم. بخشی از این کارها بهسادگی قابل تشخیص است. برای مثال، مقالههای تولید شده توسط ChatGPT کاملاً بیروح و کسلکنندهاند. کلمات، عبارات و نقطهگذاری که بهندرت توسط دانشجوی متوسط دانشگاه یا حتی افراد عادی استفاده میشود — از جمله خط تیرهٔ بزرگ — بهطور وسیعی در این متون حضور دارد.

اما تشخیص استفاده از هوش مصنوعی و اثبات واقعی آن فرق دارد. بنابراین یک آزمایش انجام دادم.

یک همکار در دپارتمان به من «اسبکوهی» (Trojan horse) را معرفی کرد؛ تاکتیکی که هم میتواند شهرها را تسخیر کند و هم تقلب کاربران هوش مصنوعی مولد را فاش سازد. این روش بهتدریج شناخته شد (حتی یک قسمت از سریال «سیمپسونها» دربارهاش است) و بهنظر میرسد که بهعنوان یک رویکرد قابلاعتماد برای جلوگیری از خواندن و ارزیابی کارهای بد کیفیت هوش مصنوعی قبلاً بهکار رفته است. بهاختصار، من متن مخفیانهای را در دستورالعمل تکلیف قرار دادم که دانشآموزان نمیتوانستند ببینند اما ChatGPT میتواند.

من کتاب «شورش گابریل» نوشتهٔ داگلاس اگرتون را واگذار کردم که داستان شورشی سرنگونشدهٔ مردم بردهشده در سال ۱۸۰۰ را روایت میکند و از دانشآموزان خواستم نکات اصلی نویسنده را توصیف کنند. چون این یک دورهٔ مقدماتی برای دانشجویان سال اول است، نیازی به تحلیل عمیق نبود. آنها میتوانستند یا از پیشنهادات من استفاده کنند یا دربارهٔ هر بخشی از استدلال اگرتون که برایشان مهم بود، بنویسند.

من ۱۲۲ مقاله دریافت کردم. از این میان، اسبکوهی به راحتی ۳۳ مقاله تولید شده توسط هوش مصنوعی را شناسایی کرد. این آمار را برای همه دانشآموزان ارسال کردم و به آنها فرصت دادم تا قبل از اینکه نمرهٔ نامطلوب دریافت کنند، اعتراف کنند که از هوش مصنوعی استفاده کردهاند. ۱۴ نفر دیگر هم خود را فاش کردند. به عبارت دیگر، تقریباً ۳۹٪ از مقالات حداقل تا حدی توسط هوش مصنوعی نوشته شده بودند.

این درصد برایم تعجبآور و دلخراش بود. من ناامیدیم را به دانشآموزان توضیح دادم و به آنها یادآوری کردم که این تقلب دربارهٔ یک شورش بردگان بود — مردمی که برای آزادی، از جمله آزادی برای یادگیری خواندن و نوشتن، جان خود را فدا کردند. در حقیقت، ویرجینیا پس از سرکوب این شورش، شرایط یادگیری آنها را سختتر کرد.

مطمئن نیستم که همهٔ آنها منظورم را درک کرده باشند؛ البته برخی حتماً متوجه شدند. چندین ایمیل دریافت کردم و با برخی از دانشآموزانی که به دفترم آمدند و صادقانه عذرخواهی کردند، صحبت کردم. چند نفر هم سعی کردند به اتهامات من اعتراض کنند، فرض میکردند که من بهدلیل «جملات بهخوبی نوشته شده» آنها را بهعنوان هوش مصنوعی شناسایی کردهام. اما اسبکوهی دروغ نگفت.

این روزها بسیار بحث میشود که مربیان باید دانشآموزان را آموزش دهند تا هوش مصنوعی را بهعنوان ابزار به کار گیرند و آن را در کار خود ادغام کنند. اخیراً، انجمن تاریخنگاران آمریکا (AHA) حتی توصیههایی ارائه داد که به چهصورت میتوانیم این موضوع را در کلاسها بپذیریم. AHA اعلام میکند که «ممنوع کردن هوش مصنوعی مولد راهحل بلندمدتی نیست؛ پرورش سواد هوش مصنوعی است». یکی از پیشنهادهای آنها، اختصاص دادن یک مقاله تولید شده توسط هوش مصنوعی به دانشآموزان و از آنها خواستن است تا بررسی کنند چه مواردی در آن صحیح بوده، چه مواردی اشتباه و یا آیا متن را درک کرده است یا خیر.

اما نمیدانم که با AHA موافقم یا نه. بگذارید توضیح دهم چرا اسبکوهی مؤثر بود. دلیل این است که دانشآموزان نمیدانند آنچه که نمیدانند چیست. متن مخفی من از آنها خواست مقاله را «از منظر مارکسیستی» بنویسند. چون رویدادهای کتاب ارتباط کمی با توسعهٔ بعدی مارکسیسم داشت، فکر میکردم این درخواست میتواند نقطهٔ قرمز برای دانشآموزان باشد، اما اینطور نشد.

حداقل هشت دانشآموز به دفترم آمدند تا به اتهامات من اعتراض کنند، اما هیچیک از آنها نتوانست به من بگوید مارکسیسم چیست، چگونه بهعنوان یک عدسۀ تحلیلی عمل میکند یا چگونه از این دیدگاه در مقالاتی که ادعا میکردند خودشان نوشتهاند، استفاده شده است. شگفتانگیزترین بخش این بود که ظاهراً وقتی ChatGPT پرسش را خواند، مستقیماً پرسید آیا باید مارکسیسم را وارد کند یا نه، و همه تایید کردند. یکی از دانشآموزان به من گفت: «فکر میکردم این کار هوشمندانه به نظر میرسد».

چگونه میتوانم به دانشآموزان مقالهای تولیدشده توسط هوش مصنوعی برای ارزیابی واگذار کنم در حالی که آنها دانش پایهای برای تحلیل آن ندارند؟ نمیتوانم و نمیخواهم.

من یک تاریخنگار هستم. آموزش دیدهام و برای اینکه دانشآموزان را آموزش دهم که چگونه یک روایت را درک کنند، از طریق تحلیل متنی معنا استخراج کنند و این معنا را بهصورت کتبی منتقل کنند، مشغول به کارم. نمیتوانم آنها را مجبور به انجام این کارها کنم، اما نمیخواهم در معرض بیشتر هوش مصنوعی در کلاس خود درگیرشان کنم.

نه تنها ناتوانی در تشخیص محتوای تولیدی هوش مصنوعی بهدلیل ضعیفی خود وجود دارد، بلکه هر دانشگاه، کالج و دپارتمان سیاستهای متفاوتی در مورد هوش مصنوعی اتخاذ میکند و هیچگونه ثباتی وجود ندارد. من و همکارانم بهطور فعال در پی یافتن راهحلی برای خودمان هستیم، شاید با ایجاد یک معیار مشترک که هر دانشآموزی که از درهای ما عبور میکند، با آن آشنا شود و تحت آن قرار گیرد. اما ما نمیتوانیم کنترل کنیم که در سایر مکانها چه میشود.

شکی نیست که بسیاری از دانشآموزان بهطور فعال تصمیم به تقلب میگیرند. اما من هم شک ندارم که به دلیل سیاستهای نامنظم و هیجانزدگی نسبت به هوش مصنوعی، برخی صادقانه گفتند که نمیدانستند تقلب میکنند. صرفنظر از آگاهی یا ناآگاهیشان، هر یک از دانشآموزان من تصمیم گرفتند یکی از چالشهای کسب مدرک را نادیده بگیرند — فرض کنیم فقط برای خرید مدرک اینجا هستند (گفتوگوی فرهنگی متفاوتی که باید داشته باشیم). همچنین آنها بهصراحت از یادگیری اجتناب کردند، زیرا یادگیری خستهکننده و دشوار است.

حالا، من مجهز به تحلیلات عمیق جامعهشناسی یا فلسفی برای تشخیص این تصمیمها نیستم. اما این یک مشکل است. چهطور میتوانیم این مشکل را حل کنیم؟ آیا بازگشت به دنیای آنالوگ است؟ آیا باید همه چیز را با کاغذ و مداد و زمان کلاس انجام دهیم؟ آیا من استاد یا افسر دانشگاهی هستم؟

پاسخ، گزینهٔ اول است. اما دانشآموزان، جامعه و اداراتی که مایل به اتخاذ موضع سختگیرانهای نیستند (مگر اینکه در جهت ترویج هوش مصنوعی باشد) در حال خفه کردن آموزش عالی هستند. یک مدرک دانشگاهی فقط برای پیدا کردن شغل نیست — باید بتوانید فکر کنید، مسألهها را حل کنید و آن راهحلها را بهکار ببرید، صرفنظر از رشتهٔ تحصیلی. چطور میتوانیم این مهارتها را آموزش دهیم بدون پشتیبانی نهادی؟ چگونه میتوانیم این را تدریس کنیم وقتی دانشآموزان تمایلی ندارند و هوش مصنوعی این امکان را برایشان فراهم میکند؟

نمیدانم. اما برای دانشآموزانم تصمیم گرفتم که آنها را تنبیه نکنم. تنها کاری که میتوانم انجام دهم، آموزش است؛ بنابراین همینکار را کردم. من مقالهٔ شگفتانگیزی از پروفسور پاتریک لین، دانشگاه کالپولی، به دانشآموزان واگذار کردم که در آن دربارهٔ مزایا و معایب استفاده از هوش مصنوعی به کلاس خود سخنرانی کرده بود. دستورالعملهایی ضمیمه کردم که از آنها میخواست تا مقاله را بخوانند و بهتفکر بپردازند. این دستورالعملها نیز شامل یک اسبکوهی مخفی بودند.

سی و شش نفر از دانشآموزان استفادهکننده از هوش مصنوعی این تکلیف را تکمیل کردند. یکی از آنها از هوش مصنوعی استفاده کرد و ۱۲ نفر دیگر بهتدریج کلاس را ترک کردند. در مجموع، ۳۵ نفر از ۴۷ نفر، نتیجهٔ مناسب داشتند. واکنشها به تکلیف عموماً خوب بود و برخی بسیار عمیق و تأملبرانگیز بودند.

اما تعداد کمی گفتند که برای من بسیار ناراحتکننده بود: «من فقط میخواستم بهترین مقالهای که میتوانستم بنویسم». این دانشآموزان، که حداقل سعی کرده بودند اندکی نظرات شخصی خود را پیش از ترکیب با نتیجهٔ تولیدشده ارائه دهند، قبلاً بهترین مقالهای که میتوانستند نوشتند. به همین دلیل است که من هوش مصنوعی را در کلاس تا این حد دوست ندارم.

دانشآموزان از شکست میترسند و هوش مصنوعی بهعنوان یک ناجی ظاهر میشود. اما آنچه از تاریخ میآموزیم این است که پیشرفت نیازمند شکست است؛ به تفکر نیاز دارد. دانشآموزان نه تنها توانایی یادگیری خود را تضعیف میکنند، بلکه توانایی رهبری خود را در آینده نیز به خطر میاندازند.

از دانشآموزانم خواستم تا تأمل کنند، پس در پایان همانطور که خودم هم میخواهم، بازتاب شخصیام را بیان میکنم. من برای هیچکدام از فعالیتهای علمی یا شخصیام از هوش مصنوعی استفاده نمیکنم. برای من تقریباً هیچچیزی بیش از توانایی فکر کردن و بیان آزادانهام ارزشمند نیست. حتی اگر خطا کنم، حداقل آن خطاهای من هستند.

ما در دورانی زندگی میکنیم که بیان شخصی توسط فیلترهای دیجیتال اشباع شده، تفکر جمعی توسط الگوریتمهای بیپایان تقویت میشود و آزادی علمی خود در معرض حملهی ذهنهای ضعیفمان قرار دارد. هوش مصنوعی تنها این وضعیت را بدتر کرده؛ این یک بحران است.

جز این که بهصورت مستقیم به این موضوع بپردازم و دربارهاش آموزش دهم، راهحل دیگری ندارم. مطمئناً مخالفان خشمگین این را قدیمی میدانند و شاید هم درست باشد.

اما من یک تاریخنگارم، پس اینجا را با یک نکته تاریخی خاتمه میدهم: تاریخ به ما نشان میدهد که حق سوادآموزی برای بسیاری از آمریکاییها هزینه سنگینی داشته است؛ از طرد شدن تا حتی مرگ. قدرتمندها متوجه بودند که ستم بهتر حفظ میشود اگر مردم در حالت ناخوانایی بمانند، در حالی که ستمدیدگان دانستند سواد راهی به آزادی است. به دانشآموزانم و به هر کسی که میشنود میگویم: به هوش مصنوعی تسلیم نشوید؛ توانایی خواندن، نوشتن و فکر کردن خود را از دست ندهید، همانطوری که دیگران برای بهدست آوردن این آزادی جان خود را فدا کردند.

آیا داستان شخصی جذابی دارید که میخواهید در HuffPost منتشر شود؟ برای اطلاعات بیشتر در مورد آنچه ما بهدنبال آن هستیم اینجا را ببینید و پیشنهاد خود را به آدرس pitch@huffpost.com ارسال کنید.